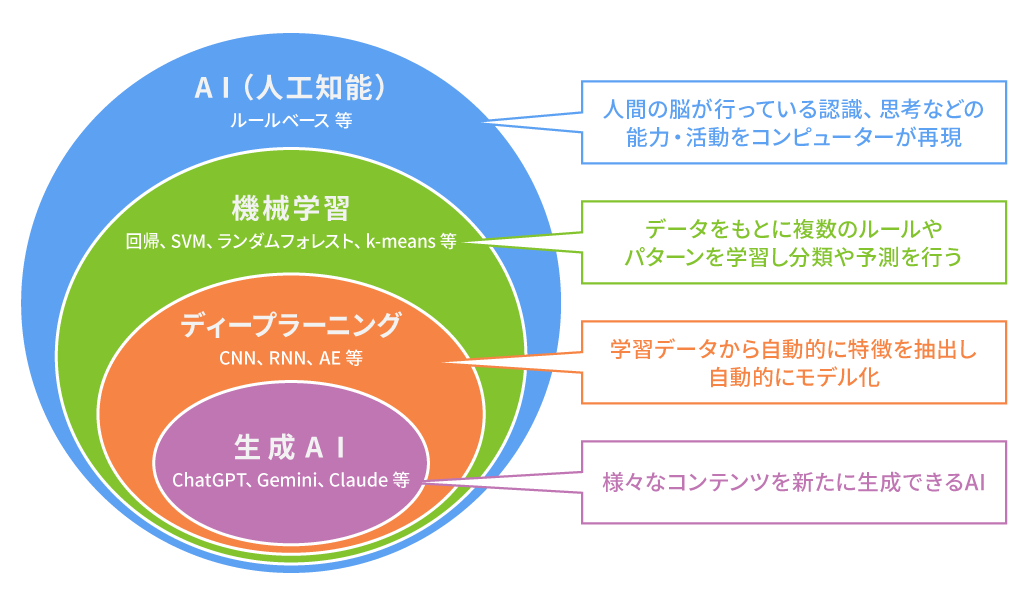

生成AIについて

生成AIとは

- 学習済みのデータを活用して新たなコンテンツを生成するAI

- 生成できるコンテンツとして有名なのはテキスト、画像、音声、動画

- ディープラーニング(ニューラルネットワーク)を用いた自然言語処理分野の研究が急速に進んだ結果、ChatGPTのような高度な文章生成能力を持つAIを開発することができた

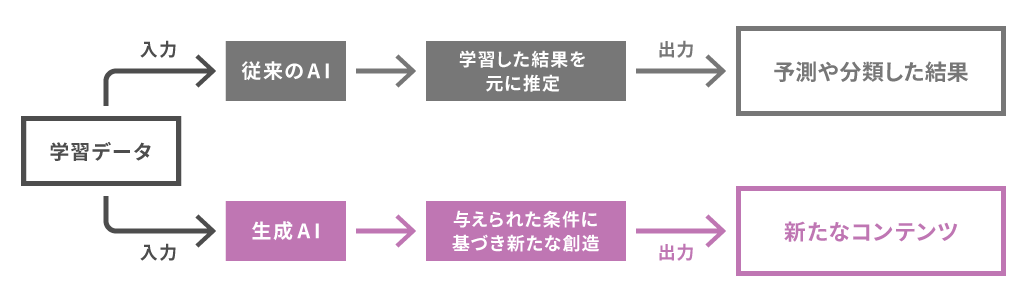

従来のAIと生成AIの関係

従来のAIと生成AIの違い

従来のAIは「学習した結果を元に何かを予測したり分類する性質」を持っていたが、

生成AIは「0から1を生み出すことができる性質」であることが特徴的。

すでに学習した結果を元に推定した答えを返すだけでなく、与えられた条件に基づいて新たな創造をして、新たなコンテンツを生み出すことができる。

生成する際は生成AIに「プロンプト」と呼ばれる指示や質問を入力する必要がある。

ChatGPTについて

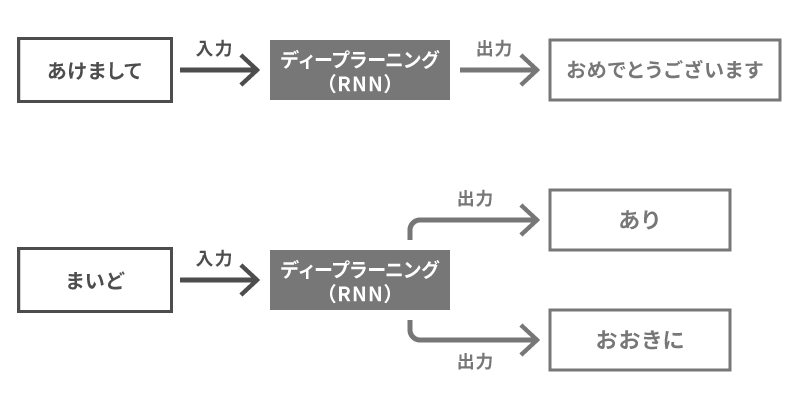

どのように進化した?

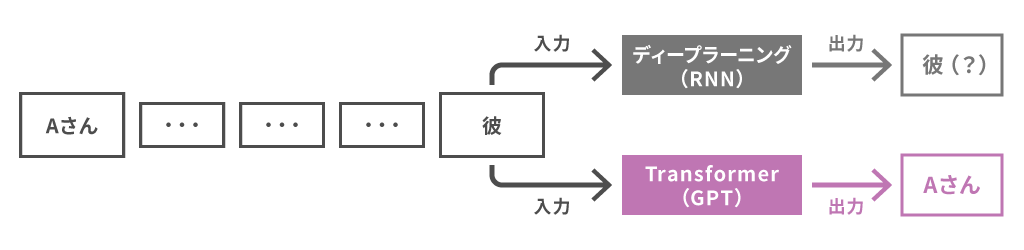

- 今まで自然言語処理で多く用いられてきたディープラーニング(RNN)では、文章の中の単語のように連続するデータを順番に認識していって、関係性を理解した上で、次に何が来るのかというのを予測していた。

- 今までのディープラーニングでは、最初の方に「Aさん」という固有名詞が出てきて、最後の方に「彼」という代名詞が出てきた場合、「彼」が誰のことを指してるのか単語を順番に認識していっているため、理解できない。

- 研究が急速に進んだ結果、並列処理と長期記憶ができるモデル(Transformer)が開発された。並列処理とはつまり、文章を一度にすべて処理して、単語間の関係性を理解することが出来る。

- 離れた場所にある単語の関係性も理解できるため、最後に出てくる「彼」が誰を指すのか判断できるようになった。

- 長い文章などのデータが入力された場合でも、前半の内容を忘れずに後半まで処理を行うことが可能に。

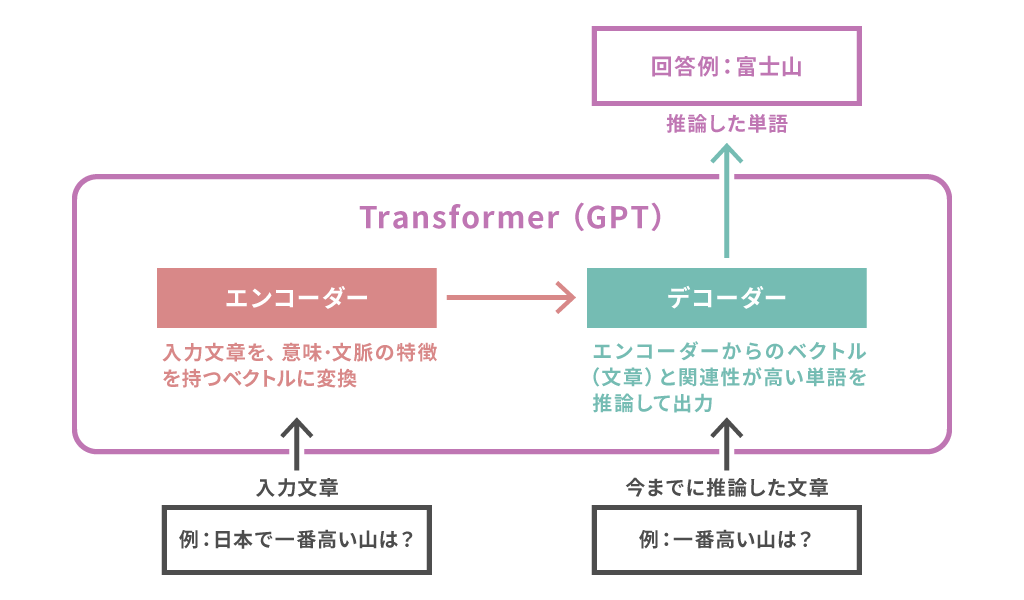

Transformerの仕組み

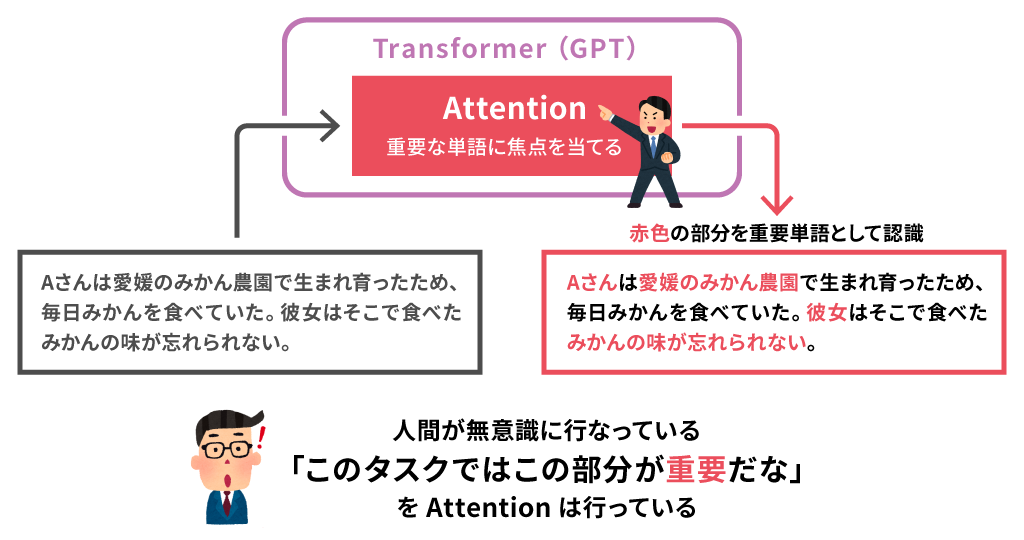

エンコーダー・デコーダ共に「Attention」という仕組みが使用されている。

Attentionについて

- Transformerは、「Attention」というメカニズムを中心に設計されている。

「Attention」とは、与えられた文章から文中の「最も」重要な情報はどの単語かを判断し焦点を当てる仕組み。 - エンコーダーの「Attention」は、単語と単語の関係を数値化する。

関係性が高い=重要な単語を認識することで入力文章の構造を理解する。(例えば「それ」が何を指すかなどの代名詞の関係) - デコーダーの「Attention」は、同じように重要な単語を認識しますが、エンコーダーで出力されたベクトルも考慮して、次の単語を生成するためにどの単語が重要か理解する。